Am 5. November 2025 kam die Community für kritische Zukunftsforschung zusammen, um einen Slogan ernst zu nehmen, den sie seit zwei Jahren mit sich trägt: Zukunft entzaubern und neu denken. Als offene Frage, als Praxis, als gemeinsames Erkunden.

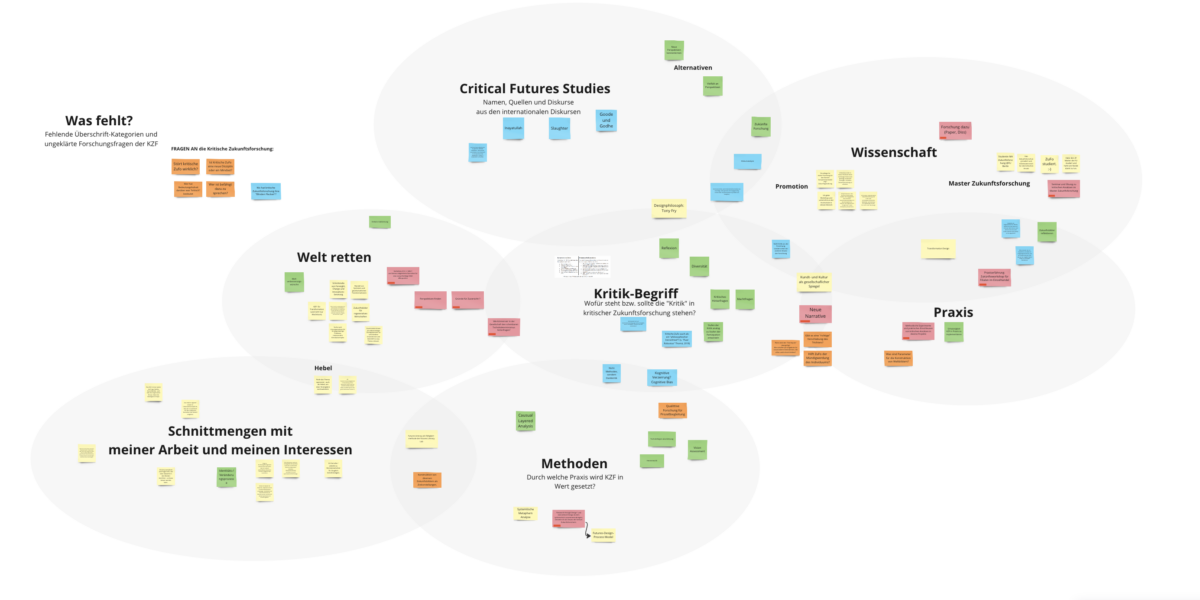

Zwei Philosophin*nen gaben Impulse, Breakout-Gruppen diskutierten, ein Miro-Board füllte sich mit Gedanken. Was folgt, ist ein Versuch, die Muster aus diesem Abend zu verdichten.

Warum überhaupt dieser Slogan?

Jonas Drechsel als Co-Initiator des Projekts legte zu Beginn etwas offen, das selten ausgesprochen wird: Den Claim hat niemand nach grundlegender Analyse formuliert. Er sollte Eigenständigkeit signalisieren und die Kernperspektive von KZF widerspiegeln. Better done than perfect. Diese Transparenz über den eigenen Ausgangspunkt zeigt, wo das Denken tatsächlich begann.

Fachtermini wären wohl Dekonstruktion und Alternativenextrapolation – doch in der Community werden bewusst offenere Begriffe gewählt. „Entzaubern“ und „neu denken“ sind anschlussfähiger. Gleichzeitig birgt das Risiko: Der Wunsch nach dem Neuen als Erlösungsmythos funktioniert im Prinzip genauso wie Zukunftswerbung. Kauft unser Produkt, dann wird alles gut. Kauft unseren Begriff, dann denkt ihr richtig.

Das „Neu“ im Slogan meint deshalb etwas anderes: Neu als Remixer. Etwas, das das Alte mitdenkt, auch wenn es das vielleicht gar nicht will. Inayatullahs Futures Triangle hilft dabei: Vergangenheit, Gegenwart und mögliche Zukünfte zusammendenken, statt so zu tun, als entstehe das Neue aus dem Nichts. Und weil gegenwärtige Machtverhältnisse über Zukunftsvorstellungen immer wieder konstruktiv in Frage gestellt werden sollen, braucht es Gegenmacht – verstanden als Ermutigung, das scheinbar Selbstverständliche zu hinterfragen.

Die philosophischen Impulse des Abends

Ina Schmidt, Philosophin und Autorin von Wofür es sich zu denken lohnt, brachte Hannah Arendts Formulierung mit: Denken ist ähnlich weltbildend wie Häuserbauen. Das klingt abstrakt, meint aber etwas sehr Konkretes. Denken formt die Welt, in der gelebt werden soll – eine zutiefst praktische Tätigkeit. In einer Gegenwart, die nicht mehr weiß, was bewahrenswert ist, braucht es ein Denken, das Ambivalenzen aushält und Widersprüche in Handlung überführt. Philosophie als Kulturtechnik. Methoden als Kulturtechnik.

Manuel Scheidegger, Philosoph und Gründer von Argumented Reality, brachte eine provokantere These mit: Denken heißt, sich und die eigenen Kriterien infrage stellen zu lassen. Immer wieder Anfänger*in werden. Zukunft ist ontologisch – also in ihrer Grundstruktur – unvorhersehbar. Deshalb ist produktive Dummheit keine Schwäche, sondern Kernkompetenz. Buddhism’s beginner’s mind als Haltung für Zukunftsforschung. In einer Gegenwart, in der KI-Systeme Antworten in Sekundenschnelle liefern, erscheint das als radikaler Akt: Bessere Fragen stellen, statt schnellere Antworten zu konsumieren.

Beide Impulse arbeiten sich an derselben Herausforderung ab: Wie bleibt Denken eine Praxis, die offen hält, was geschlossen scheint? Wie wird Zukunft zu etwas, das gestaltet werden kann, statt nur verwaltet zu werden?

Wie hängen die Prinzipien zusammen?

Die Erkenntnisse aus Diskussionen und Miro-Board lassen sich zu sechs Mustern verdichten. Sie bilden eine Bewegung: von der Analyse zur Haltung, von der Haltung zur Praxis, von der individuellen zur kollektiven Ebene. Jedes Prinzip beantwortet eine spezifische Frage – zusammen ergeben sie eine Antwort darauf, was Entzaubern und Neu-Denken bedeuten kann.

1. Unsichtbares sichtbar machen

Frage: Wovon gehen wir aus, ohne es zu bemerken?

Den Ausgangspunkt bildet eine analytische Geste: die verborgenen Mechanismen offenlegen, die Zukunftsvorstellungen prägen. Welche Annahmen stecken hinter einer Aussage? Aus welcher Position wird gesprochen? Welche Paradigmen strukturieren, was überhaupt als möglich gilt?

Das ist der eigentliche Zaubertrick der Zukunft – dass bestimmte Vorstellungen so selbstverständlich wirken, dass sie unsichtbar werden. Entzaubern beginnt mit dem Transparent-Machen dieser Grundlagen. Annahmen benennen, Positionen offenlegen, Muster erkennen. Scheidegger formuliert das als Kernkompetenz: spannend sind die unsichtbaren, unerhörten Gedanken in den Köpfen der anderen.

2. Anders statt neu – Prozess statt Ergebnis

Frage: Was meinen wir eigentlich, wenn wir „neu“ sagen?

„Neu“ trägt eine Falle in sich: Es impliziert eine Verbesserungslogik, einen Bruch mit dem Alten, ein Ziel, das bereits bekannt ist. Produktiver ist der Begriff „anders“ – er lässt Raum für Unerwartetes, ohne es vorab zu bewerten.

Das bedeutet auch: mehr Prozess, weniger festgeschriebenes Ergebnis. Häuser bauen, ohne zu wissen, welches Haus dabei herauskommt – und bereit sein, sie wieder einzureißen. Arendts Formulierung trifft das: Denken als weltbildende Tätigkeit. Neue Methoden sind dabei ebenso relevant wie neue Inhalte. Wie gedacht wird, verändert, was gedacht werden kann.

3. Handeln statt planen

Frage: Wo entsteht Zukunft eigentlich?

Zukünfte entstehen in der Gegenwart – durch Handeln, durch direkte Erfahrung, durch iteratives Testen. Die Warte-auf-das-richtige-Konzept-Haltung verpasst genau das. Zaubertricks lernen bedeutet: selbst ausprobieren, was passiert, wenn Annahmen verschoben werden.

Direkte Erfahrung im Hier und Jetzt zählt mehr als versprachlichte Regeln über das, was kommen wird. Agency entsteht im Tun. Zukunftsforschung als Gegenwartsgestaltung – das war eine der zentralen Verschiebungen des Abends. Erwünschte Zukünfte brauchen Arbeit in der Gegenwart. Das ist weniger romantisch als es klingt, aber deutlich wirkungsvoller.

4. Unvoreingenommene Offenheit kultivieren

Frage: Mit welcher Haltung gehe ich in das Unbekannte?

Im Workshop tauchte der Begriff „kindliche Weisheit“ auf – und er trifft etwas Wichtiges. Scheidegger bringt Buddhism’s beginner’s mind als Haltung für Zukunftsforschung ins Spiel: immer wieder Anfänger*in werden, die eigenen Kriterien infrage stellen lassen, „Dummheit als Kernkompetenz“. Das klingt provokant. Gemeint ist eine Offenheit jenseits vorhandener Gewissheiten: sich einlassen auf das Andere, Paradigmen transzendieren statt nur kritisieren.

Das ist eine Haltung, die geübt werden muss – gerade weil Expertise und Erfahrung dazu neigen, Wahrnehmungsmöglichkeiten einzuengen. Offenheit gegenüber dem Anderen heißt auch: Widerstände verstehen, bevor man sie bewertet. Was steht hinter der Aussage der anderen?

5. Sichere Räume für kollektive Praxis schaffen

Frage: Unter welchen Bedingungen gelingt gemeinsames Denken?

Neu denken gelingt selten allein und noch seltener unter Druck. Es braucht Räume, in denen faire Fehlerkulturen existieren, in denen Austausch über Zukünfte möglich ist, ohne dass Positionen sofort verteidigt werden müssen. Ina Schmidts Perspektive auf Philosophie als Kulturtechnik weist in diese Richtung: Solidarische Verständnisbereitschaft, die Fähigkeit, bekanntzugeben, was einen ankommen lässt.

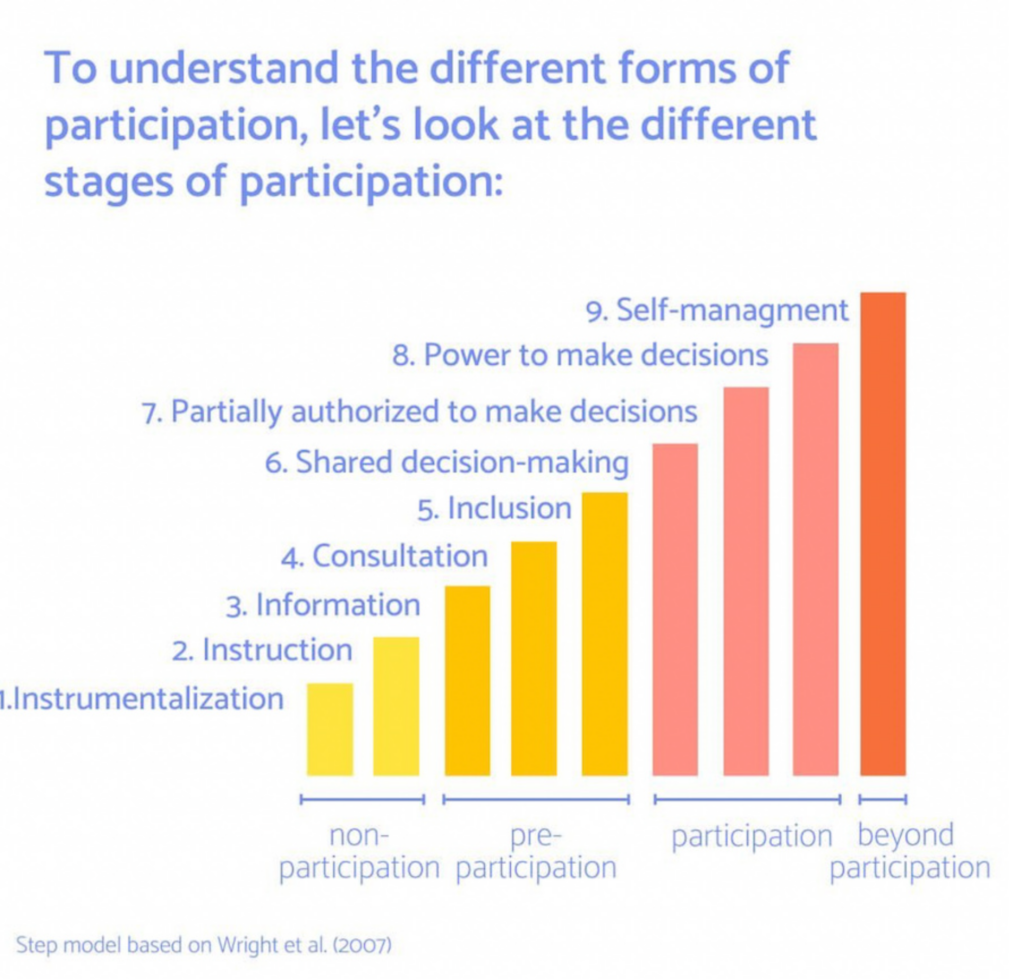

Partizipation ist dabei strukturelle Voraussetzung. Welche Bedürfnisse stehen hinter unterschiedlichen Zukunftsvorstellungen? Der Gegenpol wird gebraucht – als produktive Spannung. Und dieser Gegenpol entsteht nur, wenn der Raum dafür gehalten wird.

6. Fragilität als Ausgangspunkt nehmen

Frage: Was ist eigentlich der Status von Zukunft?

Scheidegger formuliert es klar: Zukunft ist ontologisch unvorhersehbar. Das klingt ernüchternd, ist aber eher befreiend. Die scheinbare Stabilität von Zukunftsvorstellungen war ohnehin Konstrukt – aus Annahmen, Positionen, Machtverhältnissen zusammengesetzt. Sie kann also auch anders zusammengesetzt werden: partizipativ, reflektiert, bewusst gestaltet.

Positive Verunsicherung war einer der Begriffe, die im Breakout entstanden. Das trifft den Gedanken gut. Nach dem Entzaubern entsteht Gestaltungsraum.

Eine Bewegung, kein Rezept

Die Prinzipien lassen sich als Spiralbewegung lesen: Analyse (1) schafft die Grundlage für eine veränderte Begrifflichkeit (2), die in Handlung überführt wird (3), getragen von einer bestimmten Haltung (4), die kollektiv geübt wird (5) – auf der Basis einer realistischeren Einschätzung dessen, was Zukunft überhaupt ist (6).

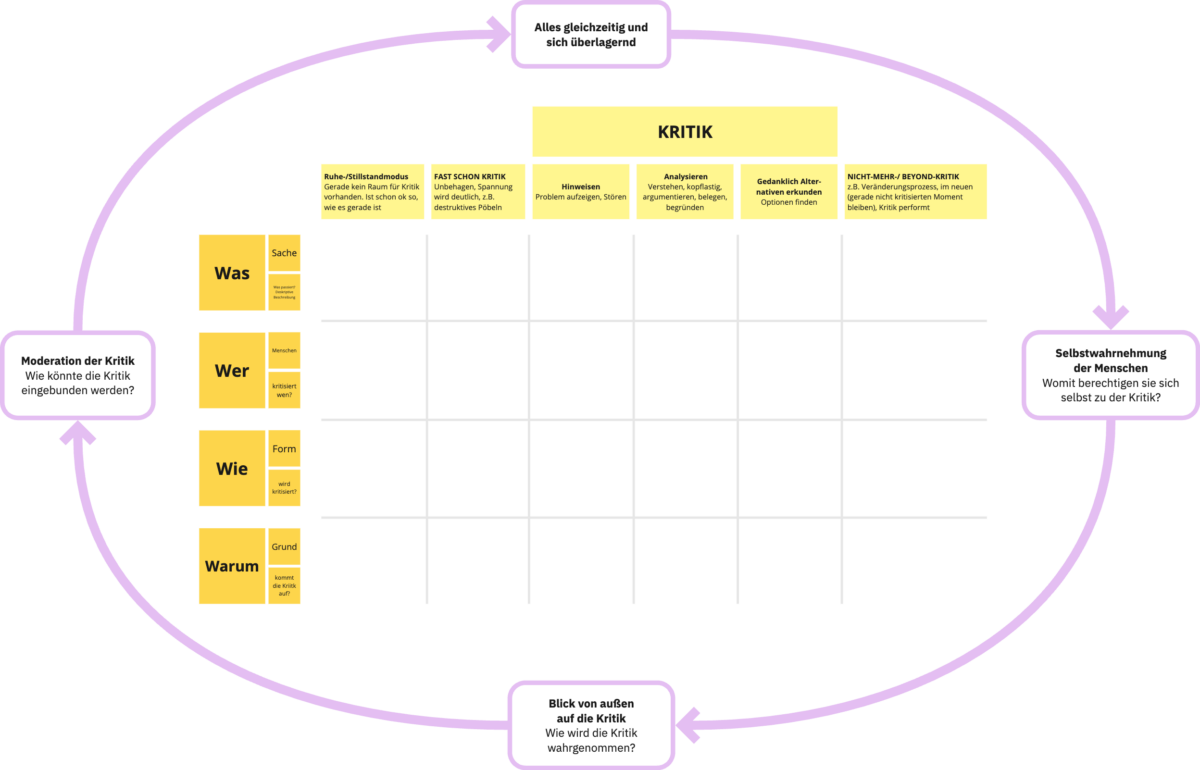

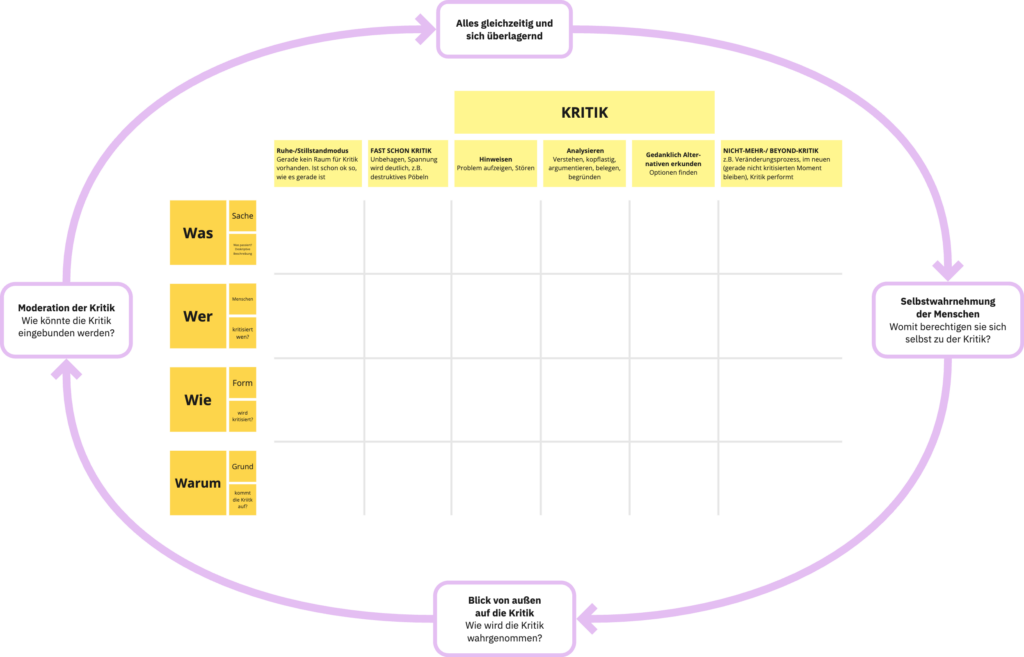

Kein linearer Prozess. Eher ein ständiges Zurückkommen auf dieselben Fragen, mit jeweils mehr Klarheit darüber, was eigentlich gefragt wird. Hier sind wir wieder beim in der Community entwickelten Kritikreisel: Verstehen, was hinter Zukunftsvorstellungen steht. Stören, wo scheinbare Gewissheiten erstarrt sind. Erkunden, welche Alternativen möglich werden. Transformieren, was sich verändern lässt.

Der Abend selbst war Beleg dafür. Zwei Stunden, viele Stimmen, ein Miro-Board voller Fragmente. Kein fertiges Ergebnis. Dafür viele Ansatzpunkte zum Weitermachen.